Основной вывод

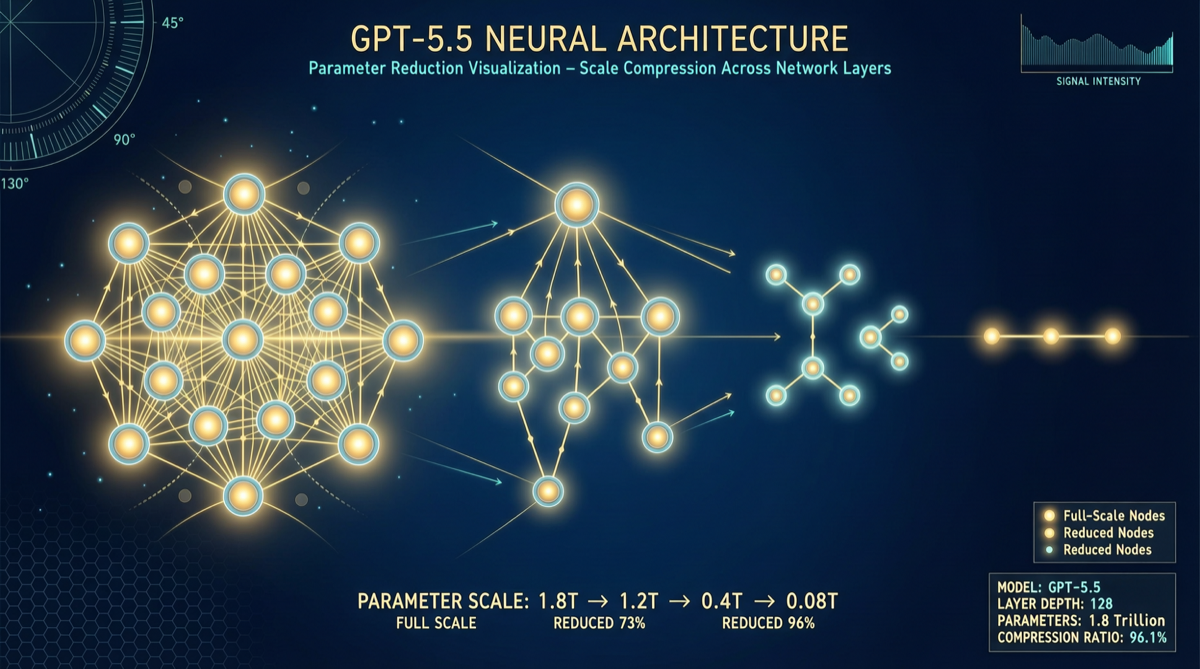

Количество параметров GPT-5.5 было пересчитано примерно в 1,5 триллиона, что значительно ниже ранее широко цитируемой оценки в 9,7 триллиона — это означает, что предыдущая оценка имела погрешность в 6,5 раз.

Это не игра в числа. Если модель на 1,5T может достичь производительности, которая, как ранее считалось, требовала 10T, это означает, что OpenAI совершила качественный скачок в эффективности архитектуры модели. Меньше параметров = ниже затраты на обучение + быстрее вывод + меньший объём при развёртывании.

Сравнение данных: Как оценка оказалась ошибочной

| Версия | Первоначальная оценка | Пересчёт | Множитель ошибки |

|---|---|---|---|

| GPT-5.5 | 9,7T | 1,5T | 6,5× |

Оценка параметров всегда была горячей темой в сообществе, поскольку OpenAI никогда официально не раскрывала конкретные цифры. Предыдущая оценка в 9,7T базировалась на экстраполяции поведения модели — когда модель демонстрировала определённые способности, сообщество склонно было считать, что «для этого нужно столько параметров».

Но перерасчёт использовал более точные методы: анализ использования VRAM при выводе, паттернов активации и структуры графа вычислений для обратной инженерии реального масштаба параметров.

Почему это важно

1. Скачок в эффективности обучения

Если модель на 1,5T может обеспечить производительность, которая, как ранее считалось, требовала 10T, это означает:

- Значительное снижение затрат на обучение: В 6,5 раз меньше параметров теоретически пропорционально снижает вычислительные потребности при обучении

- Более быстрые циклы итераций: Меньшие модели означают более быстрые циклы обучения, что объясняет способность OpenAI поддерживать ежемесячный темп выпуска

- Снижение затрат на вывод: Уменьшенные требования к памяти GPU и энергопотреблению при развёртывании

2. Возможности архитектурных инноваций

Количество параметров — не единственный фактор, определяющий способности модели. Следующие технические подходы могут улучшить производительность без увеличения параметров:

| Техническое направление | Описание | Потенциальный вклад |

|---|---|---|

| Оптимизация архитектуры MoE | Более эффективный выбор экспертов и маршрутизация | Те же активированные параметры, но меньше общих |

| Улучшение механизма внимания | Более эффективное использование информации | Более сильное представление при равных параметрах |

| Качество обучающих данных | Фильтрация данных и учебное планирование | Улучшенная эффективность данных |

| Масштабирование при выводе | Увеличение вычислений во время теста | Динамическое расширение вычислений в рантайме |

3. Влияние на отраслевой ландшафт

Если OpenAI действительно лидирует в эффективности моделей, это будет иметь волновые эффекты по всей отрасли:

- Anthropic: Серия Claude известна большим количеством параметров (серия Opus, как полагают, превышает 10T). Если GPT достигает сопоставимой производительности с меньшим количеством параметров, Anthropic сталкивается с возросшим ценовым давлением.

- Сообщество открытого исходного кода: Модели Qwen, Llama и другие модели с открытым исходным кодом конкурируют по логике «использование открытых параметров против закрытых чёрных ящиков». Если эффективность чёрного ящика значительно превышает ожидания, трудность догоняния для моделей с открытым исходным кодом возрастает.

- Поставщики оборудования: Меньшие модели означают сниженные требования к памяти GPU, что потенциально влияет на стратегию продаж серверных GPU Nvidia.

Параллельный темп выпуска: Ежемесячный стал нормой

С декабря 2025 по апрель 2026 частота выпуска моделей OpenAI и Anthropic сжалась примерно до одного раза в месяц:

| Вендор | Выпуски Дек 2025 - Апр 2026 |

|---|---|

| OpenAI | GPT-5.2 → 5.3 Codex → 5.4 → 5.5 |

| Anthropic | Opus 4.5 → 4.6 → Sonnet 4.6 → Mythos → Opus 4.7 |

Если GPT-5.5 действительно имеет только 1,5T параметров, этот ежемесячный темп становится гораздо более устойчивым как с инженерной, так и с финансовой точки зрения.

Рекомендации к действию

- Разработчики: Обратите внимание на фактическую производительность GPT-5.5 в Codex и API — если задержка вывода и затраты значительно снижены, скорректируйте стратегию выбора модели для вашего приложения.

- Корпоративные лица, принимающие решения: Количество параметров — не единственный критерий при покупке моделей. Если GPT-5.5 достигает производительности конкурентов с 9T+ при 1,5T, его экономическая эффективность заслуживает переоценки.

- Исследователи: Методология оценки параметров заслуживает глубокого изучения — как точно определить масштаб архитектуры без доступа к весам модели, это интересная техническая тема.

- Сохраняйте осторожность: Текущие данные перерасчёта получены из исследований сообщества и не были официально подтверждены OpenAI. Окончательные цифры могут всё ещё отличаться.