Основной вывод

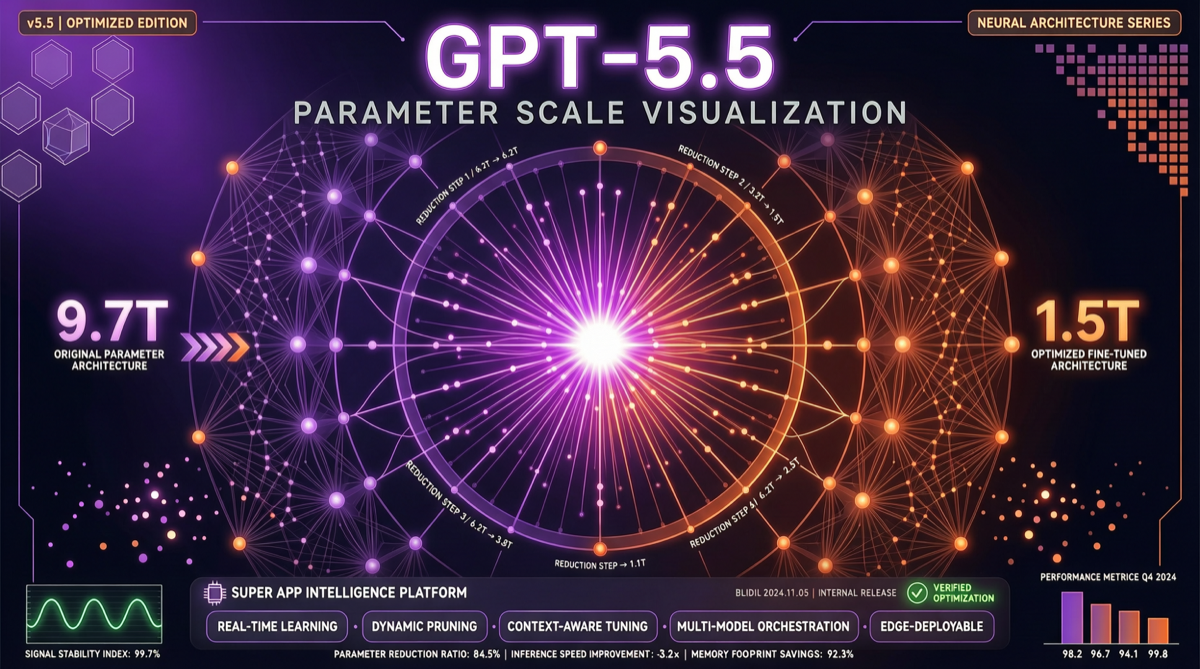

Количество параметров GPT-5.5 было пересчитано — не широко распространённые 9,7 триллиона, а 1,5 триллиона. Разница в 6,5 раза. Это означает, что OpenAI достигла эквивалентной или превосходящей производительности с моделью, значительно меньшей, чем ожидал кто-либо. Это не просто техническая победа — это颠覆ление всего отраслевого нарратива «гонки параметров».

Что означает пересчёт

Сравнение чисел

| Оценка | Параметры | Источник |

|---|---|---|

| Первоначальная оценка | 9,7T | Ранние утечки/предположения |

| Пересчитано | 1,5T | Пересчёт исследователей |

| Разница | 6,5x | — |

Разница в 6,5 раза при равной или лучшей производительности указывает на несколько ключевых фактов:

1. Massive скачок в эффективности обучения

OpenAI достигла качественного скачка в эффективности обучения с GPT-5.5:

- Качество данных важнее количества: Более тщательно отобранные обучающие данные компенсируют меньший размер параметров

- Оптимизация архитектуры: Вероятны значительные улучшения в механизмах внимания, позиционном кодировании или стратегии MoE

- Эффективность RLHF/пост-обучения: Скорость итераций от GPT-5.2 → 5.3 → 5.4 → 5.5 указывает на высокую зрелость конвейера пост-обучения

2. От «законов масштабирования» к «законам эффективности»

Индустрия давно верила в «scale is all you need» — больше параметров, больше данных, больше вычислений等于更好的模型。GPT-5.5 предполагает:

Эффективность обучения > масштаб параметров

Это имеет глубокие последствия:

- Малым командам не нужно гнаться за триллионными параметрами для создания хороших моделей

- Стоимость вычислений больше непреодолимый барьер

- «Маленькие модели, большой интеллект» может стать мантрой второй половины 2026

GPT-5.5: больше чем обновление модели

Часть стратегии «супер-приложения»

Репортаж Reuters раскрывает более широкое позиционирование GPT-5.5 — это ключевой компонент трансформации ChatGPT в платформу:

- Функции продуктивности: Обработка документов, электронная почта, управление календарём

- Интеграция поиска: Встроенная возможность поиска в реальном времени

- Создание контента: Мультимодальные генеративные возможности

- Автоматизация: Оркестрация агентов Codex

Это не «лучший чат-бот» — это OpenAI строит единый AI-шлюз.

Сжатый ритм выпуска

С декабря 2025 по апрель 2026 темпы выпуска OpenAI были ошеломляющими:

2025.12 → GPT-5.2

2026.02 → GPT-5.3 (Codex)

2026.03 → GPT-5.4

2026.05 → GPT-5.5Почти одно крупное обновление в месяц. Anthropic итерирует с аналогичной скоростью (Opus 4.5 → 4.6 → 4.7). «Цикл выпуска» AI-индустрии сжался с лет до месяцев.

Связь с GPT-5.6

Ещё интереснее то, что следы GPT-5.6 уже обнаружены во внутренних логах Codex. Если GPT-5.5 — это «первая базовая модель, переобученная с нуля с GPT-4.5», то GPT-5.6 может означать:

- Ещё более экстремальную оптимизацию эффективности параметров

- Совершенно новые методы обучения или стратегии данных

- Возможно, продолжение маршрута «меньше параметров, больше мощности»

Сэм Альтман уже дразнит GPT-5.6. При нынешнем темпе мы можем увидеть его к июню-июлю 2026.

Оценка ландшафта

Влияние на конкурентов

- Claude/Anthropic: Opus 4.7 теперь сталкивается с новым конкурентным измерением — «эффективность параметров». Маршрут Anthropic «меньше, но умнее» подтверждён этим пересчётом

- DeepSeek/открытый исходный код: Количество параметров 1,5T означает, что порог追赶 для открытых моделей ещё снижается

- Google/Gemini: Ритм выпуска Gemini 3.1 Pro сжимается; необходимо ответить в измерении эффективности

Влияние на индустрию

- Ожидания спроса на вычисления снижены: Если 1,5T может соответствовать тому, что ожидалось от 9,7T, стоимость обучения значительно снижается

- Сообщество открытого исходного кода выигрывает: Меньший размер параметров означает более лёгкое воспроизведение и тонкую настройку

- Нарратив «гонки масштабирования» заканчивается: Фокус отрасли смещается с «чья модель больше» на «чье обучение эффективнее»

Рекомендации к действию

- Если вы планируете закупку вычислений: пересмотрите свои потребности — моделей уровня 1,5T может быть уже достаточно

- Если вы выбираете модели: не смотрите только на количество параметров — сосредоточьтесь на эффективности обучения и фактической производительности задач

- Если вы следите за открытым исходным кодом: маршрут эффективности GPT-5.5 предоставляет новую стратегию для открытых моделей — улучшайте качество обучения, а не просто наращивайте параметры