Ключевой вывод

Практические тесты Qwen3.6-27B на NVIDIA GB10 подтверждают ключевую тенденцию: 27B-классные модели с открытым исходным кодом преодолевают аппаратные барьеры, переходя от «требуются несколько 4090» к «можно запустить на одной краевой карте».

Это не новость о прорыве производительности — это новость о прорыве доступности. Когда модели уровня фронтира с открытым исходным кодом могут работать на потребительских краевых устройствах, порог участия в локальных AI-исследованиях переопределяется.

Данные тестирования

Разработчики сообщества сообщают:

- Модель: Qwen3.6-27B (квантование Q6)

- Оборудование: NVIDIA GB10 (краевая версия суперчипа Grace Blackwell)

- Статус: «умеренно пригодна» — функциональна, но не максимальная производительность

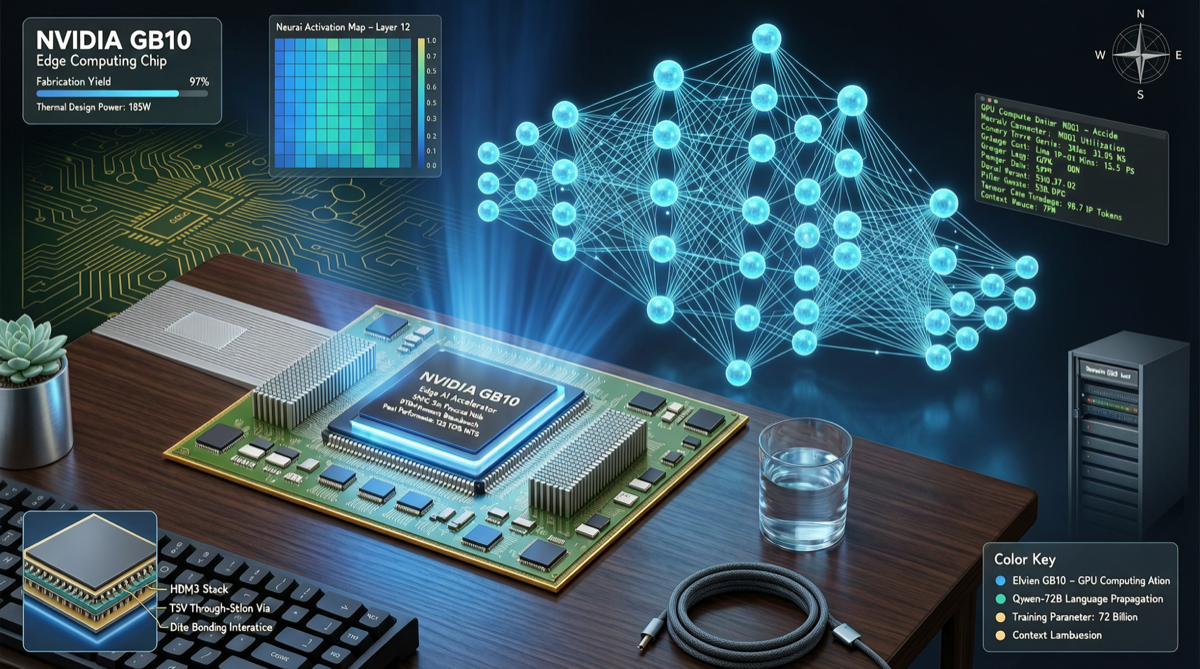

GB10 — это продукт NVIDIA для краевого инференса, интегрирующий процессор Grace и GPU Blackwell, разработанный для энергоэффективного, высокоплотного локального AI-инференса. Квантование Q6 сжало занимаемую 27B-моделью память до уровня, который GB10 может обработать.

Почему это важно

1. 27B — оптимальный размер для открытых моделей

Qwen3.6-27B — это не просто какая-то модель, это флагманская версия с открытым исходным кодом из серии Alibaba Qwen 3.6, показывающая отличные результаты в множестве бенчмарков:

| Показатель | Qwen3.6-27B | Сравнение |

|---|---|---|

| Открытые веса | ✅ Лицензия MIT | Не требуется коммерческая лицензия |

| Способность к рассуждению | Уровень фронтира | Приближается к дистилляции рассуждений уровня Opus |

| Локальное развертывание | Работает на одной карте (после квантования) | Потребительское оборудование подходит |

Масштаб в 27 миллиардов параметров находится точно на балансе между «достаточно умная» и «реально запускаемая».

2. Краевое позиционирование GB10

GB10 — это не датацентровый GPU, а интегрированное решение для краевых сценариев. Его ключевые преимущества:

- Низкое энергопотребление: Подходит для развертывания на настольных/краевых устройствах

- Высокая интеграция: CPU + GPU объединены, снижение сложности системы

- Экосистема NVIDIA: Совместимость с CUDA, зрелая цепочка инструментов

Запуск Qwen3.6-27B на GB10 означает, что модели этого уровня теперь можно развертывать на офисных настольных компьютерах, рабочих станциях разработчиков и даже в домашних лабораториях.

3. Стратегическое значение локального инференса

Когда модели могут работать локально, решается несколько ключевых проблем:

- Конфиденциальность данных: Чувствительные данные не покидают устройство

- Постоянная доступность: Нет зависимости от квот API или сетевого подключения

- Контроль затрат: Разовое вложение в оборудование, безлимитные вызовы инференса

- Кастомизация: Возможность загрузки локальных баз знаний и пользовательских промптов

Сравнительный анализ: выбор решения для краевого инференса

| Решение | Стоимость оборудования | Размер модели | Скорость инференса | Сценарий использования |

|---|---|---|---|---|

| GB10 + Qwen3.6-27B Q6 | Средняя | 27B | Пригодна | Ежедневный помощник для разработки, исследовательские прототипы |

| RTX 4090 + Qwen3.6-27B Q4 | Выше | 27B | Плавная | Интенсивное использование, взаимодействие в реальном времени |

| RTX 3090 + Qwen3.6-27B Q6 | Средняя | 27B | Пригодна | Ограниченный бюджет, допустимая задержка |

| Облачный API | Оплата по использованию | Без ограничений | Очень быстрая | Внезапные потребности, крупномасштабная пакетная обработка |

Руководство по началу работы

Если вы хотите попробовать локальный инференс GB10 + Qwen3.6-27B:

- Оборудование: Модуль NVIDIA GB10 (или аренда через облачный сервис)

- Модель: Загрузите квантованную GGUF-версию Qwen3.6-27B с Hugging Face

- Фреймворк инференса: Рекомендуется llama.cpp или Ollama

- Выбор квантования: Q6 — баланс между пригодностью и качеством; попробуйте Q4, если память ограничена

# Метод через Ollama

ollama run qwen3.6:27b-q6

# Метод через llama.cpp

./llama-cli -m qwen3.6-27b-q6.gguf -p "Привет, расскажи о себе"

Оценка ландшафта

Краевой инференс переходит от стадии «можно ли запустить?» к стадии «насколько хорошо работает?» Пригодная производительность Qwen3.6-27B на GB10 — это только начало. С продолжающейся оптимизацией техник квантования, спекулятивного декодирования и fused-ядер, производительность и опыт локального инференса будут продолжать улучшаться.

Для разработчиков и исследователей это означает важный стратегический выбор: вам не нужно ждать оптимального облачного решения — вы можете запустить достаточно хорошую модель локально и настроить и оптимизировать её под свои нужды.