核心结论

Qwen3.6-27B 在 NVIDIA GB10 上的实测表现证明了一个关键趋势:27B 级开源模型正在突破硬件门槛,从"需要多张 4090"走向"单块边缘卡可用"。

这不是性能突破的新闻,而是可及性突破的新闻——当 frontier-level 的开源模型能在消费级边缘设备上运行时,本地 AI 研究的参与门槛将被重新定义。

实测数据

社区开发者报告:

- 模型:Qwen3.6-27B(Q6 量化)

- 硬件:NVIDIA GB10(Grace Blackwell 超级芯片的边缘版本)

- 状态:"mildly usable"——可用,但非极致性能

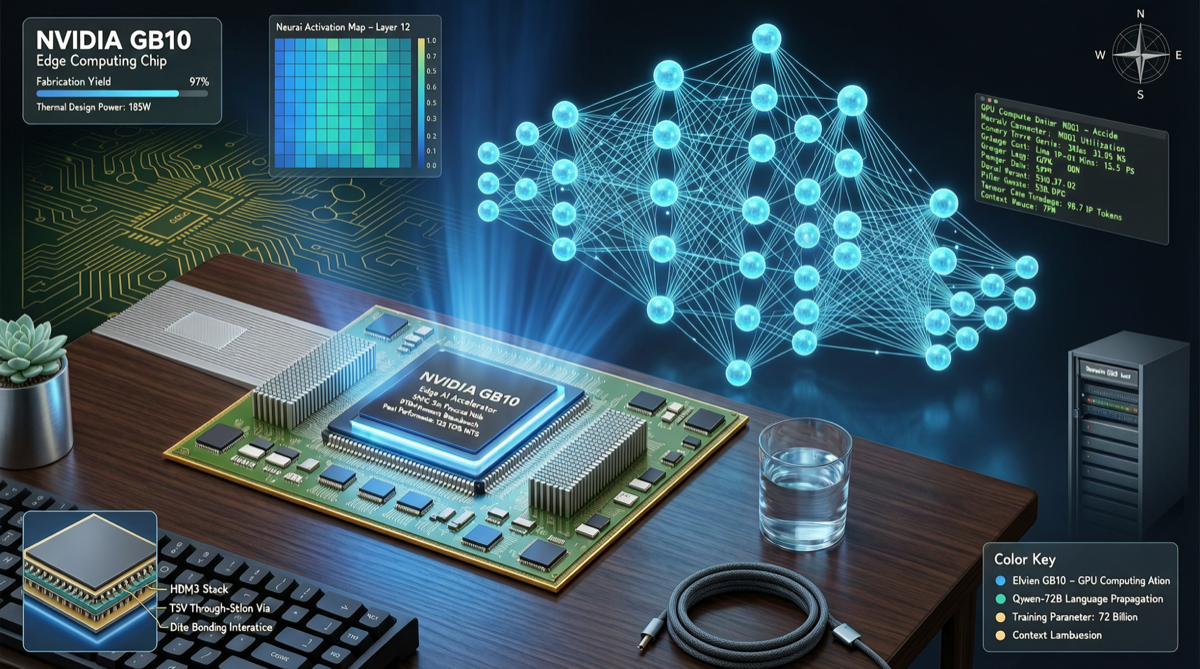

GB10 是 NVIDIA 面向边缘推理场景推出的产品,集成了 Grace CPU 和 Blackwell GPU,专为低功耗、高密度的本地 AI 推理设计。Q6 量化将 27B 模型的内存占用压缩到了 GB10 的可承受范围内。

为什么这很重要

1. 27B 是当前开源模型的甜点区

Qwen3.6-27B 不是随便一个模型——它是通义千问 3.6 系列中的旗舰开源版本,在多项基准测试中表现优异:

| 指标 | Qwen3.6-27B | 对比 |

|---|---|---|

| 开源权重 | ✅ MIT 许可 | 无需商业授权 |

| 推理能力 | 前沿水平 | 接近 Opus 级别推理蒸馏 |

| 本地部署 | 单卡可跑(量化后) | 消费级硬件可行 |

27B 参数规模恰好卡在"足够聪明"和"跑得动"的平衡点上。

2. GB10 的边缘定位

GB10 不是数据中心级别的 GPU,而是面向边缘场景的集成方案。它的核心优势在于:

- 低功耗:适合桌面/边缘设备部署

- 集成度高:CPU + GPU 一体化,减少系统复杂性

- NVIDIA 生态:CUDA 兼容性,工具链成熟

在 GB10 上跑 Qwen3.6-27B,意味着这个级别的模型已经可以部署到办公室桌面、开发工作站甚至家庭实验室中。

3. 本地推理的战略意义

当模型能在本地运行时,几个关键问题得到解决:

- 数据隐私:敏感数据不出本机

- 持续可用:不依赖 API 配额和网络连接

- 成本可控:一次硬件投入,无限次推理调用

- 定制化:可以加载本地知识库和自定义 prompt

对比分析:边缘推理方案选型

| 方案 | 硬件成本 | 模型规模 | 推理速度 | 适用场景 |

|---|---|---|---|---|

| GB10 + Qwen3.6-27B Q6 | 中等 | 27B | 可用级 | 日常开发助手、研究原型 |

| RTX 4090 + Qwen3.6-27B Q4 | 较高 | 27B | 流畅级 | 重度使用、实时交互 |

| RTX 3090 + Qwen3.6-27B Q6 | 中等 | 27B | 可用级 | 预算有限、可接受延迟 |

| 云端 API | 按量付费 | 不限 | 极快 | 突发需求、大规模批处理 |

上手建议

如果你想尝试 GB10 + Qwen3.6-27B 本地推理:

- 硬件准备:NVIDIA GB10 模块(或通过云服务租用)

- 模型获取:从 Hugging Face 下载 Qwen3.6-27B 的 GGUF 量化版本

- 推理框架:推荐使用 llama.cpp 或 Ollama

- 量化选择:Q6 是可用性和质量的平衡点;如果内存紧张可尝试 Q4

# Ollama 方式

ollama run qwen3.6:27b-q6

# llama.cpp 方式

./llama-cli -m qwen3.6-27b-q6.gguf -p "你好,请介绍一下自己"

格局判断

边缘推理正在从"能不能跑"进入"跑得好不好"的阶段。Qwen3.6-27B 在 GB10 上的可用表现只是起点,随着量化技术、推测解码(speculative decoding)和融合内核(fused kernel)的持续优化,本地推理的性能和体验将持续提升。

对于开发者和研究者来说,这意味着一个重要的战略选择:你不需要等待云端模型的最优解——你可以在本地跑一个足够好的模型,然后根据自己的需求定制和优化它。