Что произошло

В GitHub Trending PriorLabs/TabPFN продолжает удерживать лидирующие позиции с 6 650 общими звёздами и 218 звёздами за день. Тем временем SAP объявила о стратегических инвестициях более чем в €1 млрд в разработчика TabPFN — PriorLabs, и 18-месячный немецкий ИИ-стартап мгновенно стал одним из самых наблюдаемых проектов в европейском ИИ.

Какую проблему решает TabPFN

Традиционное машинное обучение сталкивается с несколькими устойчивыми проблемами при обработке табличных данных:

| Болевая точка | Традиционный подход | Подход TabPFN |

|---|---|---|

| Переобучение на малых наборах данных | Требует масштабного инжиниринга признаков | Предобученный трансформер, естественно подходит для малых данных |

| Сложность выбора модели | Нужно экспериментировать между XGBoost, Random Forest, LightGBM | Одна модель обрабатывает и классификацию, и регрессию |

| Настройка гиперпараметров занимает много времени | Grid Search / Optura занимает часы | Нулевая настройка, работает из коробки |

| Скорость вывода | Ансамблевые модели медленные | Один прямой проход завершает предсказание |

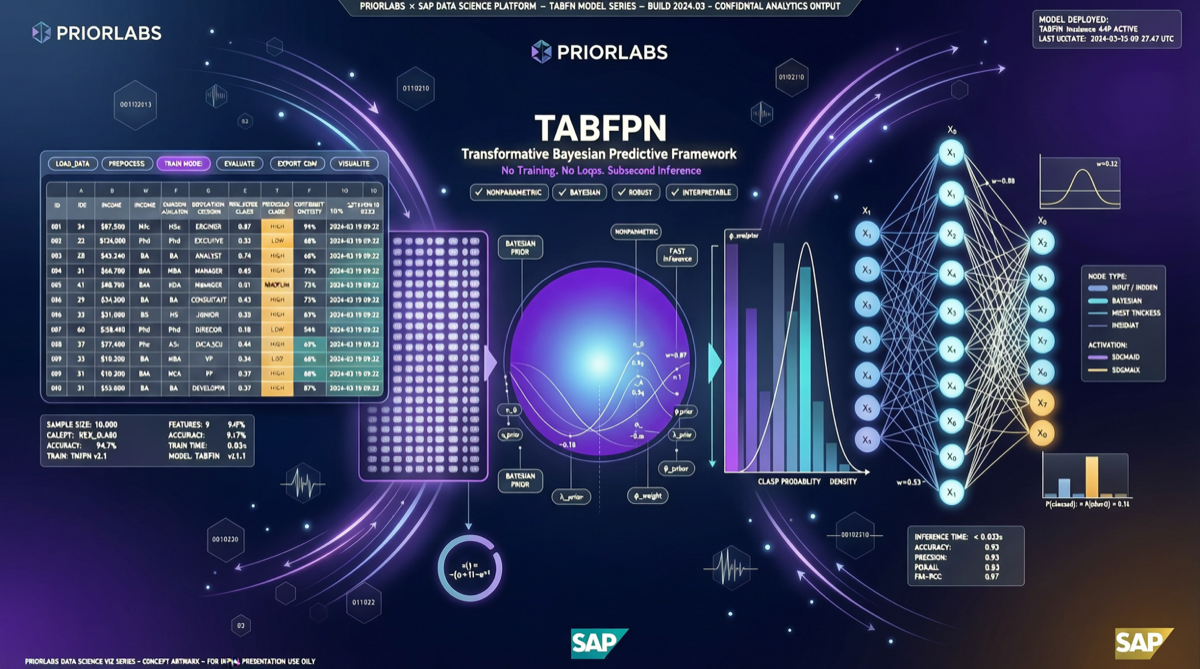

Ключевая идея Prior-Data Fitted Network (PFN) такова: на этапе обучения модель учится не напрямую из наборов данных, а учится «предсказателям, которые хорошо работают на большом количестве синтетических наборов данных». Это означает, что при столкновении с новыми данными TabPFN не нуждается в переобучении или настройке — он уже освоил универсальные паттерны табличных данных через «обучение тому, как учиться».

Почему SAP готова инвестировать €1 млрд

1. Естественное соответствие корпоративным сценариям

Основной бизнес SAP — ERP, CRM, управление цепочками поставок — все эти системы ежедневно генерируют огромные объёмы табличных данных. Классификация клиентов, прогнозирование спроса, обнаружение аномалий, оценка рисков — всё это специализация TabPFN.

2. То, что LLM делают плохо, TabPFN делает хорошо

Большие языковые модели превосходны в понимании и генерации естественного языка, но в задачах прогнозирования структурированных табличных данных — особенно в сценариях с малыми выборками — они часто уступают специализированным табличным моделям. TabPFN заполняет этот пробел в матрице ИИ-способностей.

3. Стратегическое позиционирование европейского ИИ

В условиях, когда европейские ИИ-компании в целом сталкиваются с трудностями финансирования, масштабные инвестиции SAP несут сильный стратегический замысел: вырастить отечественную компанию фундаментальных ИИ-моделей, избежать полной зависимости от американских гигантов в инфраструктуре корпоративного ИИ следующего поколения.

Техническое сравнение

| Параметр | XGBoost | LightGBM | TabPFN |

|---|---|---|---|

| Требует настройки | Да | Да | Нет |

| Производительность на малых данных | Средняя | Средняя | Отличная |

| Производительность на больших данных | Отличная | Отличная | Хорошая |

| Скорость вывода | Быстрая | Быстрая | Умеренная |

| Интерпретируемость | Средняя | Средняя | Низкая |

| Порог использования | Средний | Средний | Низкий |

Как использовать

Быстрый старт:

from tabpfn import TabPFNClassifier

from sklearn.datasets import load_breast_cancer

from sklearn.model_selection import train_test_split

X, y = load_breast_cancer(return_X_y=True)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.5)

classifier = TabPFNClassifier()

classifier.fit(X_train, y_train) # Нулевая настройка

accuracy = classifier.score(X_test, y_test)

print(f"Accuracy: {accuracy}")

Применимые сценарии:

- Базовая линия для соревнований по науке о данных (многие участники уже добились хороших результатов с ним)

- Быстрое моделирование на малых наборах данных внутри предприятий

- Автоматизированные ML-пайплайны, не требующие поддержки сложной логики настройки

Примечание: В настоящее время TabPFN лучше всего подходит для наборов данных с количеством строк до 10 000. Для ультрамасштабных данных традиционные градиентные бустинговые деревья остаются лучшим выбором.

Оценка ландшафта

Раунд финансирования PriorLabs на €1 млрд отмечает «вертикальные доменные фундаментальные модели» как новую горячую точку в ИИ-инвестициях. После LLM (язык) и диффузионных моделей (изображения) вертикальные домены, такие как табличные данные, временные ряды и графовые данные, могут каждый пережить свой собственный «момент фундаментальной модели».