发生了什么

GitHub Trending 上,PriorLabs/TabPFN 以 6,650 总星、单日 218 星的增速持续占据榜单前列。与此同时,SAP 宣布对 TabPFN 的开发商 PriorLabs 进行超过 10 亿欧元 的战略投资——这家成立仅 18 个月的德国 AI 初创公司瞬间成为欧洲 AI 领域最受瞩目的项目之一。

TabPFN 解决什么痛点

传统机器学习在处理表格数据(tabular data)时面临几个顽疾:

| 痛点 | 传统方案 | TabPFN 方案 |

|---|---|---|

| 小数据集过拟合 | 需要大量特征工程 | 基于先验训练的 Transformer,天然适配小数据 |

| 模型选择困难 | 要在 XGBoost、Random Forest、LightGBM 之间反复试验 | 单一模型统一处理分类和回归 |

| 超参数调优耗时 | Grid Search / Optuna 耗时数小时 | 零调参,开箱即用 |

| 推理速度 | 集成模型推理慢 | 一次前向传播完成预测 |

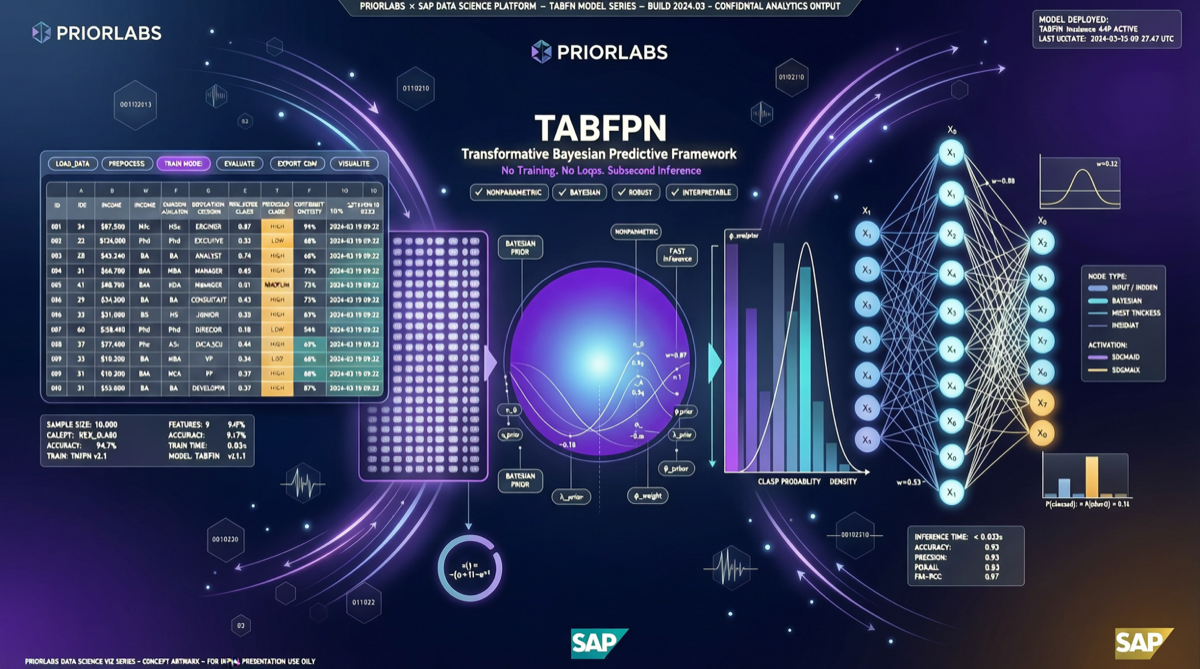

Prior-Data Fitted Network(PFN) 的核心思路是:在训练阶段,模型不是直接学习数据集,而是学习"在大量合成数据集上表现良好的预测器"。这意味着当遇到新数据时,TabPFN 不需要重新训练或调参——它已经在"学习如何学习"的过程中掌握了表格数据的通用模式。

为什么 SAP 愿意砸 10 亿欧元

1. 企业场景的天然契合

SAP 的核心业务是 ERP、CRM、供应链管理——所有这些系统每天都在产生海量的表格数据。客户分类、需求预测、异常检测、风险评估……这些都是 TabPFN 的拿手好戏。

2. LLM 做不好的事情,TabPFN 能做

大语言模型在自然语言理解和生成上表现出色,但在结构化表格数据的预测任务上——尤其是小样本场景——往往不如专门的表格模型。TabPFN 补上了 AI 能力矩阵中的这个短板。

3. 欧洲 AI 的战略卡位

在欧洲 AI 公司普遍面临融资困境的背景下,SAP 的巨额投资具有强烈的战略意图:扶持一家本土 AI 基础模型公司,避免在下一代企业 AI 基础设施上完全依赖美国巨头。

技术对比

| 维度 | XGBoost | LightGBM | TabPFN |

|---|---|---|---|

| 是否需要调参 | 是 | 是 | 否 |

| 小数据集表现 | 一般 | 一般 | 优秀 |

| 大数据集表现 | 优秀 | 优秀 | 良好 |

| 推理速度 | 快 | 快 | 中等 |

| 可解释性 | 中等 | 中等 | 低 |

| 使用门槛 | 中 | 中 | 低 |

可以怎么用

快速上手:

from tabpfn import TabPFNClassifier

from sklearn.datasets import load_breast_cancer

from sklearn.model_selection import train_test_split

X, y = load_breast_cancer(return_X_y=True)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.5)

classifier = TabPFNClassifier()

classifier.fit(X_train, y_train) # 零调参

accuracy = classifier.score(X_test, y_test)

print(f"Accuracy: {accuracy}")

适用场景:

- 数据科学竞赛的 baseline(很多选手已经用它拿了好成绩)

- 企业内部的小数据集快速建模

- 需要自动化 ML 流水线但不想维护复杂调参逻辑的场景

注意事项:TabPFN 目前最适合行数在 10,000 以内的数据集。对于超大规模数据,传统梯度提升树仍然是更好的选择。

格局判断

PriorLabs 的 10 亿欧元融资标志着"垂直领域基础模型"正在成为 AI 投资的新热点。继 LLM(语言)、扩散模型(图像)之后,表格数据、时间序列、图数据等垂直领域都可能出现各自的"基础模型时刻"。