结论

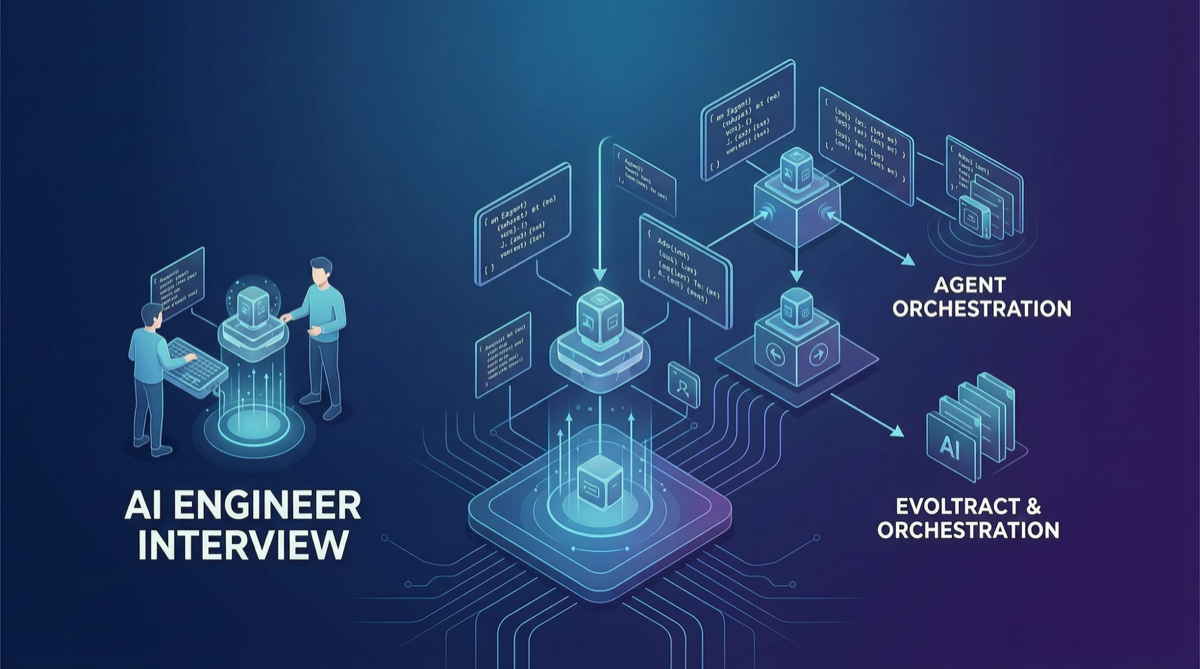

2026 年的 AI 工程师面试不再只考 LeetCode 和系统设计。我们正在从”构建聊天机器人”转向”构建自主操作者(Autonomous Operators)“。面试的核心考察点已经从算法和编码转向了 Agent 架构设计、工具集成和任务编排。

六大核心考点

1. Agent 架构设计

典型问题:如何设计一个能自主完成多步任务的 Agent?

考察点:

- 工具选择策略(何时调用什么工具)

- 上下文管理(长对话中的信息压缩和检索)

- 错误处理(工具调用失败后的恢复机制)

实战建议:熟悉 OpenClaw 的技能框架(Skills Framework),理解 Agent 如何通过 skills 定义能力和边界。

2. 工具集成与 MCP

典型问题:如何给 Agent 集成一个外部 API?

考察点:

- MCP(Model Context Protocol)的使用经验

- 工具定义的规范化(参数、返回值、错误码)

- 安全边界(哪些操作需要用户确认)

实战建议:动手写一个 MCP Server,连接一个你熟悉的 API(GitHub、Notion、数据库等)。

3. 上下文管理

典型问题:Agent 对话超过上下文窗口怎么办?

考察点:

- 上下文压缩策略(摘要、检索、分层)

- 记忆系统设计(短期记忆 vs 长期记忆)

- 成本优化(减少不必要的 token 消耗)

实战建议:理解 OpenClaw 的 follow-up commitments 机制背后的上下文推断逻辑。

4. 多 Agent 协作

典型问题:如何让多个 Agent 协作完成一个复杂任务?

考察点:

- Agent 间通信协议

- 任务分解和分配策略

- 冲突解决和结果合并

实战建议:了解 Kimi K2.6 Agent Swarm 的 300 Agent 协作架构思路。

5. 安全与权限

典型问题:如何防止 Agent 执行危险操作?

考察点:

- 权限分级(read/write/execute 控制)

- 沙箱环境

- 审批流程(human-in-the-loop)

实战建议:了解 OpenClaw 本轮更新中提到的 restrictive profiles 和 owner checks 机制。

6. 可观测性与调试

典型问题:Agent 输出不符合预期,如何排查?

考察点:

- 日志和追踪

- Agent 行为分析

- 迭代改进(prompt 调整、工具改进)

面试准备清单

| 准备项 | 推荐资源 | 时间投入 |

|---|---|---|

| 熟悉至少一个 Agent 框架 | OpenClaw / Hermes Agent | 1-2 周 |

| 实现一个 MCP Server | MCP 官方文档 | 2-3 天 |

| 构建端到端 Agent 应用 | 选一个真实场景 | 1-2 周 |

| 理解多 Agent 模式 | TradingAgents / CrewAI | 3-5 天 |

| 了解 Agent 安全实践 | OWASP LLM Top 10 | 1-2 天 |

趋势判断

正在淘汰的面试内容:

- 纯算法题(LeetCode hard)

- 传统的 CRUD API 设计

- 单纯的语言特性问答

正在成为标配的面试内容:

- Agent 系统设计

- 工具集成实操

- Prompt 工程和优化

- Agent 行为调试

这个转变的底层逻辑是:AI 时代的核心竞争力不再是”写代码的速度”,而是”编排智能体的能力”。面试考纲的变化只是反映了行业需求的变化。