"大多数人以为 AI 是一个工具。"

这条推文上周获得了 65 次浏览。不是爆款,但说中了一个事实:2026 年的 AI 已经变成了一个分层架构,每一层都是独立的采购决策、独立的成本中心、独立的故障点。

如果你还在用"选 GPT 还是选 Claude"的思维做技术选型,那你的 AI 项目可能已经在某个看不见的层面积累了技术债。

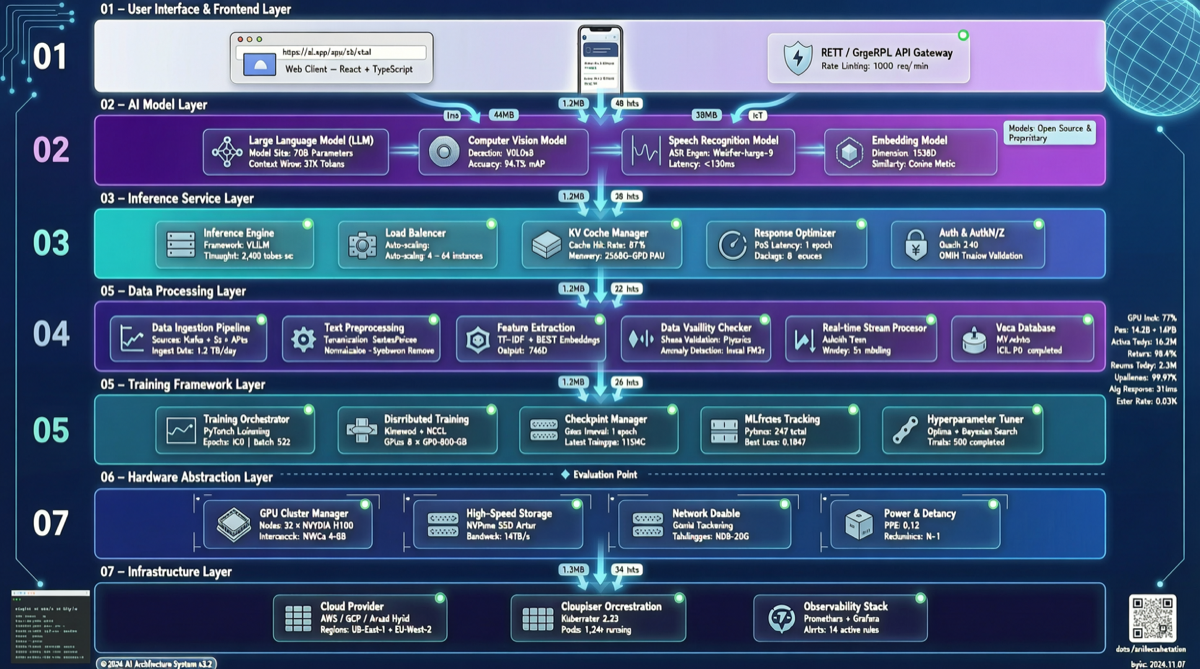

2026 年的 AI 栈

从上到下大概是这样:

第 1 层:用户界面。Web App、CLI、IDE 插件、Slack Bot、语音助手。这一层决定用户怎么和 AI 交互。

第 2 层:编排层。LangChain、OpenClaw、LangGraph、CrewAI。负责任务分解、路由、错误重试、多 Agent 协调。

第 3 层:模型路由层。决定哪个请求走哪个模型。简单问题 → GPT-4o-mini,复杂推理 → Claude Opus,代码 → DeepSeek V4。好的路由能把成本压到 40-60%。

第 4 层:基础模型层。GPT、Claude、Gemini、Qwen、DeepSeek、GLM。这是大家讨论最多的层,但实际上它只占总成本的 30-50%。

第 5 层:记忆和上下文层。向量数据库(Pinecone、Weaviate、Qdrant)、缓存(Redis)、会话管理。这一层的成本经常被低估。

第 6 层:工具和数据层。MCP 服务器、API 连接器、数据库查询接口、文件系统。Agent 能不能真正"做事"取决于这一层。

第 7 层:基础设施层。GPU 集群、推理服务(vLLM、TGI)、网络、存储。

七层。每一层都在演化,每一层都有供应商锁定风险。

哪一层最容易被忽视

记忆层(第 5 层)。

大多数团队花大量时间在第 4 层(选模型)和第 2 层(选编排框架),但对记忆层的投入严重不足。结果就是:AI 能回答复杂问题,但记不住用户上次说了什么;或者每次对话都重新加载整个知识库,推理费用飙升。

一个好的记忆架构应该做到三件事:

- 短期记忆(会话内上下文)控制在模型窗口内,避免浪费 token

- 长期记忆(跨会话知识)用向量检索按需加载,而不是每次都塞进 prompt

- 记忆更新要有版本控制,否则你会遇到"AI 记住了错误信息然后一直错下去"的问题

供应商锁定在哪一层最严重

基础模型层。看起来很明显,但很多人没意识到——一旦你的 prompt 工程、工具调用协议、输出格式解析都针对某个模型优化了,换模型的成本比你想象的高得多。

更隐蔽的锁定在编排层(第 2 层)。如果你用 LangGraph 写了 50 个 Agent workflow,换到另一个编排框架意味着重写全部逻辑。这也是为什么一些团队开始采用"轻量编排 + 标准化协议"的策略——用简单的状态机替代重量级框架,降低迁移成本。

一个实操建议

如果你刚开始构建 AI 产品,或者在重构现有的 AI 工作流:

- 先定义你的模型路由策略,再选模型。不要反过来。

- 把记忆层当成一等公民设计,而不是事后补丁。

- 在编排层保持轻量。能用 if-else 解决的路由,不要上重量级框架。

- 定期做成本审计。每月看一次各层的费用占比,找出异常增长点。

AI 栈的每一层都在快速变化。今天的最佳实践,三个月后可能就过时了。但理解这条栈的结构,能让你在变化中保持清醒。

主要来源:

- X/Twitter 社区讨论("AI is a stack" 线程,2026-05-10)

- 行业分析综合