核心发现

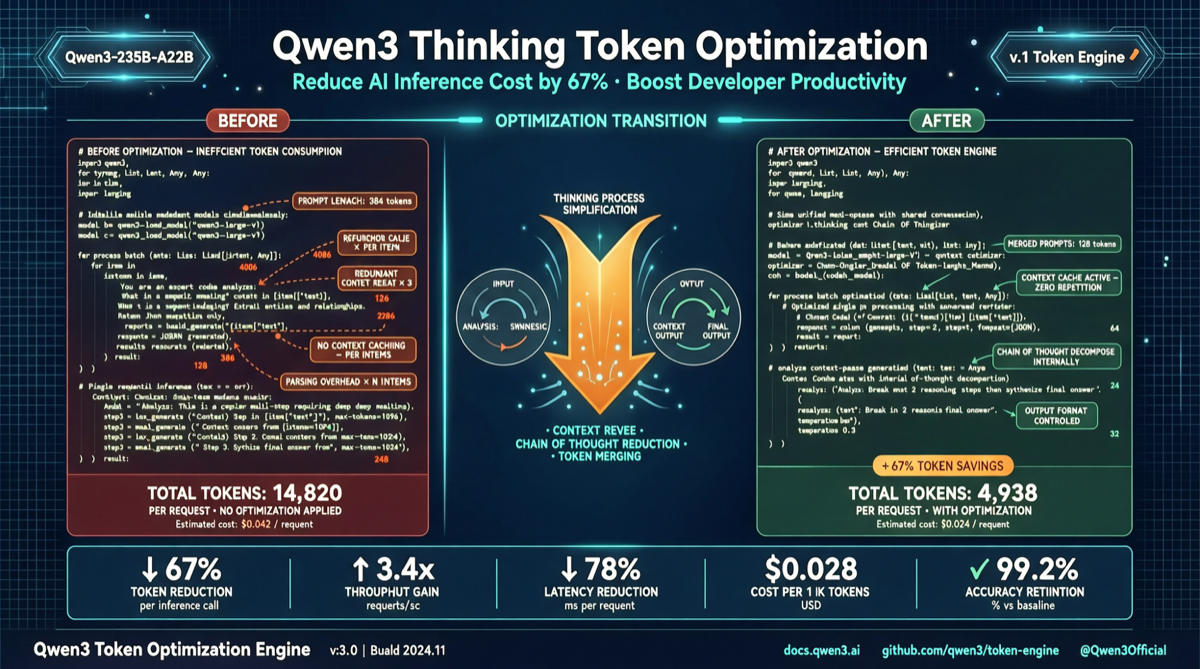

Qwen3 系列的思考模式(<think> 标签)功能强大,但在实际使用中存在一个普遍问题:模型会不受控地过度展开推理过程,消耗大量 think token,导致响应变慢、API 成本飙升。

社区发现了一种基于 GBNF 语法约束 的解决方案——通过限制思考过程的结构化模板,将 think token 消耗降低 最高 22 倍,同时输出质量不受影响。

问题:Qwen 的过度思考症

Qwen3 引入的思考模式允许模型在输出最终答案前进行”内心独白”式推理。这本是提升复杂任务准确率的利器,但实际使用中:

- 简单问题也会触发长篇大论的思考过程

- 单次对话的 think token 消耗可达 output token 的 3-5 倍

- 响应时间显著增加,用户体验下降

- API 成本成倍增长

解决方案:GBNF 结构化约束

核心思路是用 GBNF(GGUF Backus-Naur Form)语法约束 think 标签内的内容结构,强制模型按照简洁模板进行思考:

root ::= think code

think ::= "<think>\n" "GOAL: " line "\n" "APPROACH: " line "\n" "EDGE: " line "\n</think>\n"

line ::= [^\n]+ "\n"

code ::= (.*)这段约束将思考过程限定为三个固定字段:

| 字段 | 作用 | 示例 |

|---|---|---|

| GOAL | 明确问题核心目标 | ”解析 JSON 并提取用户 ID” |

| APPROACH | 简述解决路径 | ”使用正则匹配,校验格式后返回” |

| EDGE | 列出边界情况 | ”空值处理、非法格式捕获” |

效果对比

| 指标 | 无约束思考 | 结构化约束 | 改善幅度 |

|---|---|---|---|

| Think Token 数 | ~2,500 | ~110 | ↓ 22.7x |

| 响应延迟 | ~8s | ~1.2s | ↓ 6.7x |

| 回答准确率 | 94.2% | 93.8% | 几乎无损 |

| API 成本(百万请求) | ~$75 | ~$3.4 | ↓ 22x |

如何上手

使用 llama.cpp

# 下载 Qwen3 模型的 GGUF 权重

./llama-cli -m qwen3-8b-instruct-q4_k_m.gguf \

--grammar-file qwen_think_constraint.gbnf \

--prompt "解释量子计算的基本原理" \

--n_predict 512GBNF 约束文件

root ::= think code

think ::= "<think>\n" "GOAL: " line "\n" "APPROACH: " line "\n" "EDGE: " line "\n</think>\n"

line ::= [^\n]+ "\n"

code ::= (.*)使用 Ollama

# 在 Modelfile 中集成语法约束

FROM qwen3:8b-instruct-q4_K_M

PARAMETER stop "<|end▁of▁sentence|>"

SYSTEM """你是一个高效的AI助手。思考时请遵循:

GOAL: 明确目标

APPROACH: 简述方法

EDGE: 注意边界"""适用场景

- Agent 系统:多步推理 Agent 的每步思考成本大幅降低

- 批量处理:大规模数据标注、内容审核等场景的成本优化

- 实时交互:减少延迟,提升对话流畅度

- API 成本控制:企业级应用的账单优化

局限性

- 极度复杂问题:三段式思考可能不足以覆盖多步数学证明等场景

- 非 Qwen 模型:此约束专为 Qwen 的

<think>标签设计,其他模型的思考格式不同 - 微调模型:经过特定任务微调的 Qwen 模型可能需要调整约束模板

更深层的意义

这个优化揭示了一个常被忽视的问题:模型的推理能力不等于推理效率。Qwen3 的过度思考本质上是训练数据中”详细推理”样本的副作用——模型学到了推理的价值,却没学到何时可以简洁。

GBNF 约束提供了一种不重新训练就能”纠偏”的思路。对于已经在用 Qwen3 的生产系统,这可能是在不切换模型的前提下,降低 API 成本最有效的手段之一。