Agent 安全讨论的焦点一直在 prompt injection 上。但 5 月 6 日发布的一篇 arXiv 论文(2605.05440)把注意力转向了一个更少被讨论、可能也更根本的问题:授权传播(Authorization Propagation)。

作者是 Krti Tallam。论文 20 页,属于 cs.AI 分类。

核心问题是什么

当一个 AI Agent 被授权执行任务后,它可能会:

- 从数据源检索信息

- 把子任务委托给其他 Agent

- 跨不同系统边界整合结果

在这个过程中,原始授权如何随着任务的传递和数据的流动而变化?

论文指出,这不是 prompt injection 的变体,也不能用 RBAC、ABAC 或 ReBAC 这些经典访问控制模型完全解决。因为经典模型假设权限主体是人类,而 Agent 系统的核心特征是非人类主体之间的自动委托和数据流转。

三个子问题

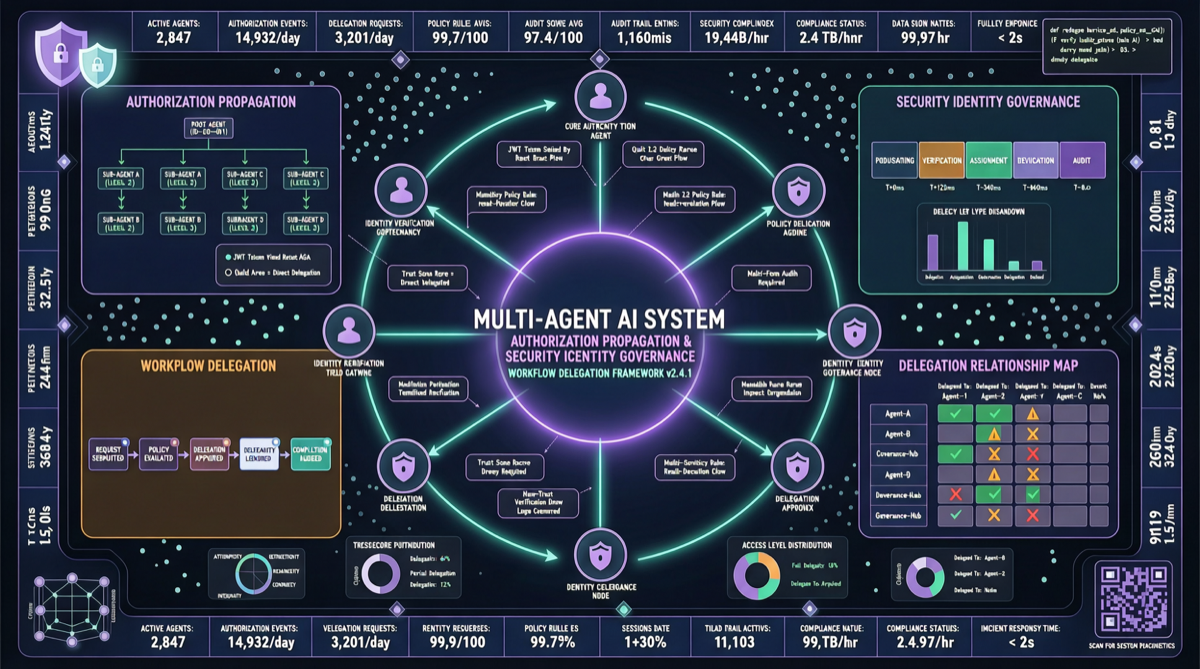

论文形式化了三个子问题:

- Transitive Delegation(传递性委托)——Agent A 把任务委托给 Agent B,Agent B 又委托给 Agent C。每一层传递中,权限应该如何衰减或保持?

- Aggregation Inference(聚合推理)——单个 Agent 获取的每一条数据都是授权的,但当多条数据被聚合后,可能推导出超出原始授权范围的结论。

- Temporal Validity(时间有效性)——授权是有时效的。但在长周期的 Agent 工作流中,任务执行过程中授权可能已经过期,而 Agent 并不知情。

这三件事,在当前大多数 Agent 框架中都没有被系统性处理。

七项架构要求

基于这三个子问题,论文推导出了多智能体系统授权架构的七项要求。其中比较关键的是:

- 授权必须在每次交互边界上被重新评估,而不是只在系统启动时检查一次

- 需要**任务范围的授权信封(task-scoped authorization envelopes)**来限制委托链中的权限范围

- 执行计数撤销机制——当 Agent 执行超过一定次数后自动撤销权限

论文提到,来自生产级企业 AI 平台的初步实施证据显示:普通的系统行为(不仅仅是对抗性攻击)就已经能产生这些授权失效。

这意味着什么

如果你正在搭建多 Agent 系统——比如用 LangChain、CrewAI 或自建编排框架——这篇论文是在提醒一个被忽视的风险:即使每个 Agent 单独来看是安全的,它们组合在一起时可能产生权限传播的级联效应。

论文的贡献不在于给出了完整的解决方案,而在于把问题形式化了。在 Agent 安全领域,这通常是解决问题的第一步。

值得跟进的方向:invocation-bound capability tokens、dependency-graph policy enforcement——这些是论文中提到的正在收敛中的技术方案。

主要来源: