核心数据

Kimi K2.5 的技术规格在开源模型中几乎是独一无二的:

| 指标 | Kimi K2.5 | 对比参照 |

|---|---|---|

| 总参数量 | 1 万亿 | GPT-5.5 预估 ~10 万亿 |

| 激活参数 | 320 亿 | 仅 3.2% 参数活跃 |

| 子代理协调 | 最多 100 个并行 | 行业典型 5-10 个 |

| 模态支持 | 文本 + 图像 + 视频原生 | 与 GPT-5.5 相当 |

| 开源策略 | 权重开放 | 对标 LLaMA 系列 |

| 推理成本 | Claude 的 1/7 | 极具性价比 |

MoE 架构的工程意义

MoE(Mixture of Experts)不是新概念,但把总参数做到 1 万亿的同时把激活参数控制在 320 亿,这需要:

- 高效的路由机制:每个 token 只激活最相关的专家,避免全参数计算

- 专家之间的负载均衡:防止某些专家过载而其他闲置

- 推理时的内存管理:1 万亿参数需要加载到内存,但只有 320 亿在计算

320 亿激活参数的推理成本远低于 1750 亿的全参数模型,但 MoE 架构让模型拥有了 1 万亿参数的知识容量。这解释了为什么 Kimi K2.5 能以 Claude 1/7 的成本提供可比性能。

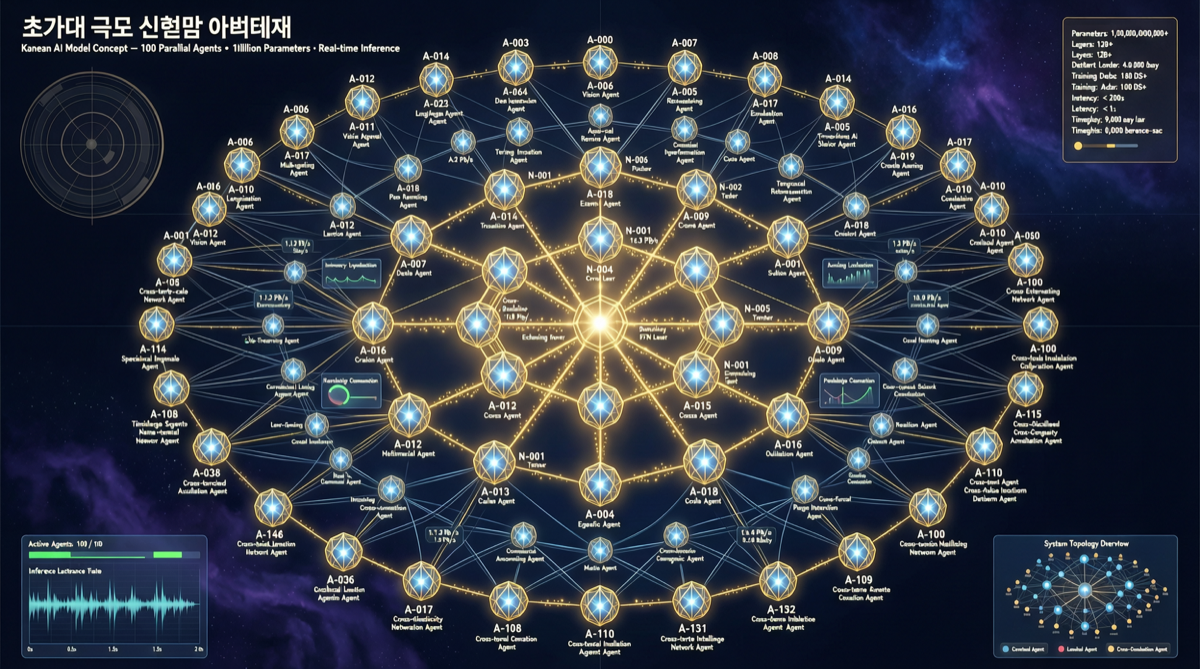

100 个子代理并行——这意味着什么?

Kimi K2.5 可以在单个请求中协调多达 100 个 AI 子代理并行工作。这不是简单的”批量调用”,而是模型内部的多线程推理。

一个具体的应用场景:

用户请求:"分析这份 500 页的财报,生成投资报告"

K2.5 内部调度:

├── 子代理 1-10:财务报表数据提取

├── 子代理 11-20:行业对比分析

├── 子代理 21-30:风险因子识别

├── 子代理 31-40:管理层讨论摘要

├── 子代理 41-50:竞争对手分析

├── 子代理 51-60:历史趋势对比

├── 子代理 61-70:ESG 评估

├── 子代理 71-80:估值模型计算

├── 子代理 81-90:图表生成

└── 子代理 91-100:最终报告整合所有 100 个子代理同时运行,最终由 Kimi K2.5 的路由层整合输出。

与现有方案的对比

| 方案 | 代理数 | 是否需要外部框架 | 推理成本 |

|---|---|---|---|

| LangChain + GPT-4 | 5-10 | 是 | 高(多次 API 调用) |

| CrewAI + Claude | 5-20 | 是 | 中高 |

| Kimi K2.5 内置 | 100 | 否 | 低(单次 API 调用) |

| DeepSeek V4 Flash | 不适用 | — | 低 |

Kimi K2.5 的关键优势在于多代理能力内建在模型中,不需要外部框架编排。这降低了工程复杂度,同时减少了多次 API 调用带来的延迟和成本。

开源的意义

Kimi K2.5 是开源的。这意味着:

- 任何人都可以下载权重并在本地运行

- 社区可以针对特定任务微调子代理行为

- 企业可以部署在自己的基础设施上,避免供应商锁定

- 研究者可以直接研究 MoE 路由和子代理协调的机制

在 Meta Muse Spark 转向闭源、Anthropic 把自研模型锁起来的背景下,Kimi K2.5 的开源策略显得尤为突出。

局限与待验证

- 100 子代理的实际效率:并行度增加不等于线性加速,子代理之间的协调开销需要实测

- 320 亿激活参数的上限:对于极度复杂的任务,320 亿激活参数可能不如 1750 亿全参数模型

- 开源权重的硬件门槛:1 万亿参数模型的推理需要大量 GPU 内存,普通开发者可能只能使用 API

格局判断

Kimi K2.5 代表了一个趋势:模型正在从”单线程推理引擎”进化为”多代理协调系统”。

在这个趋势下,传统的 Agent 框架(LangChain、CrewAI)可能逐渐被模型内置的多代理能力替代。当模型本身就能高效协调 100 个子代理时,外部编排框架的价值会被大幅压缩。

行动建议

- 开发者:试用 Kimi K2.5 的 API,特别是需要多步骤并行推理的场景(数据分析、代码审查、内容生成)

- 企业:评估将 LangChain/CrewAI 编排的部分工作迁移到 Kimi K2.5 内置多代理的可行性,可能显著降低延迟和成本

- 研究者:关注 Kimi K2.5 开源权重的 MoE 路由机制,这是理解大规模 MoE 模型行为的重要窗口