核心结论

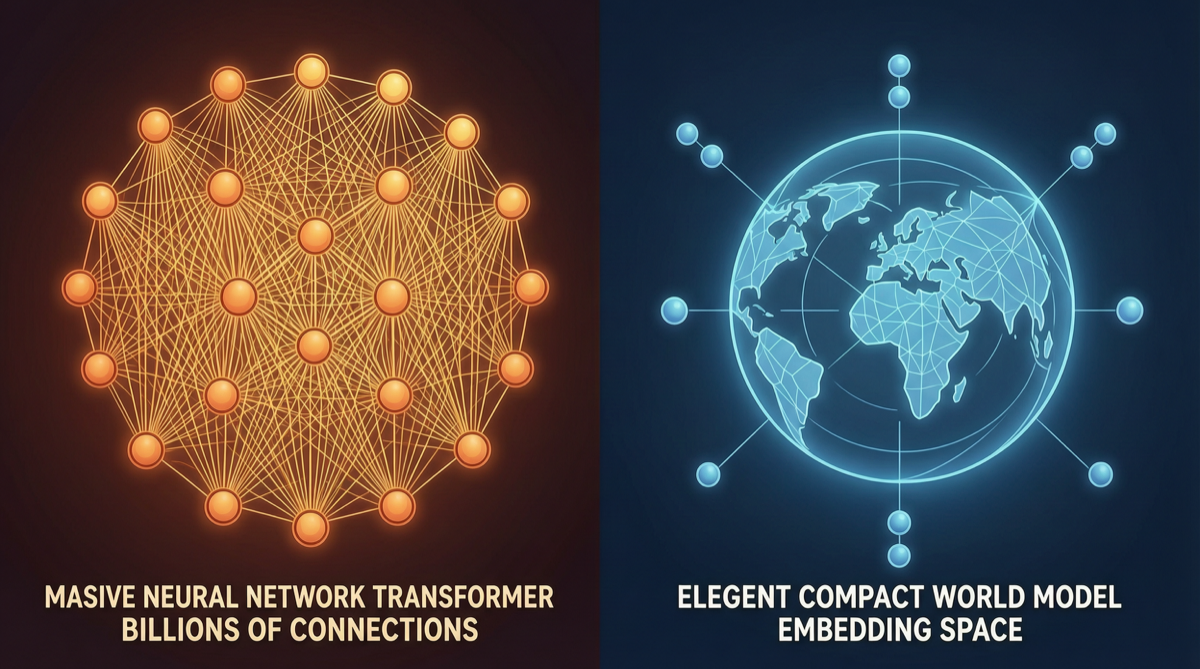

AI行业正在面临一个根本性的路线分歧:

| 维度 | LLM路线(主流) | JEPA路线(LeCun) |

|---|---|---|

| 核心架构 | Transformer + Next-Token Prediction | Joint Embedding Predictive Architecture |

| 训练方式 | 海量文本生成预测 | 联合嵌入空间中的世界状态预测 |

| 生成方式 | 自回归逐token生成 | 非生成式,在嵌入空间推理 |

| 物理理解 | 隐含学习(可能学会) | 显式编码(设计保证) |

| 计算效率 | 推理成本高(逐个生成) | 规划速度快(嵌入空间操作) |

| 典型玩家 | OpenAI, Anthropic, Google, 国产模型 | Meta (LeCun团队) |

LeCun的最新实验中,极小参数+单张GPU就实现了天然编码物理规律+超快规划。这与当前动辄千亿参数、万张GPU的LLM训练形成了鲜明对比。

LeCun的核心论点

LeCun从LLM热潮初期就反复强调一个问题:

“如果让模型足够大,它最终会理解世界是如何运行的——这个假设从未被证明。”

他的批评可以归纳为三点:

1. 自回归生成的根本缺陷

LLM通过”预测下一个词”来学习,这种方式:

- 只能学到文本的统计规律,无法真正理解物理世界

- 每一步生成都依赖前一步,推理速度线性增长

- 幻觉问题根植于”下一个token概率”的不确定性

2. 嵌入空间推理的优势

JEPA的核心思想是:

- 将世界状态编码为高维嵌入向量

- 在嵌入空间中进行预测和规划

- 不需要逐个生成token,而是直接操作抽象表征

这类似于人类思考的方式——我们不是在脑中”逐字默念”来规划行动,而是在一个抽象的空间中”想象”结果。

3. 计算效率的碾压级优势

LeCun实验中,小参数+单张GPU就实现了:

- 超快规划:嵌入空间操作比逐token生成快几个数量级

- 物理规律天然编码:不需要额外训练,架构本身就倾向于学习物理规律

- 低能耗:不依赖海量算力和数据

为什么现在突然被关注

过去三年,LLM路线一骑绝尘,JEPA的声音被淹没在Scaling Law的狂欢中。但2026年出现了一些转折点:

| 转折信号 | 含义 |

|---|---|

| GPT-5.5/Claude Opus 4.7 训练成本指数增长 | Scaling Law可能正在触及天花板 |

| 四大巨头2026年AI支出$7250亿 | 算力竞赛的财务可持续性存疑 |

| LeCun实验用小参数实现物理编码 | 另一条路可能确实走得通 |

| 社区”LLM够用但不够好”的共识 | 90%场景LLM够用,但关键场景仍有差距 |

技术对比:JEPA vs LLM

LLM路线:

输入文本 → 分词 → Transformer层层计算 → 逐token生成输出 → 解码为文本

↑ 计算密集,每一步都昂贵

JEPA路线:

输入感知 → 编码器提取嵌入 → 在嵌入空间预测/规划 → 解码器输出

↑ 在抽象空间操作,计算量大幅降低| 能力 | LLM | JEPA |

|---|---|---|

| 文本生成 | ★★★★★ | ★★ |

| 代码生成 | ★★★★★ | ★★ |

| 物理推理 | ★★ | ★★★★★ |

| 规划速度 | ★★ | ★★★★★ |

| 训练效率 | ★★ | ★★★★ |

| 泛化能力 | ★★★★ | ★★★★★ |

对行业的影响

如果JEPA被证明可行

- AI成本结构将彻底改写:不需要万张GPU训练,中小公司也能做出强模型

- Agent能力的质变:规划和推理速度提升几个数量级,真正的自主Agent成为可能

- Meta的战略优势:如果JEPA路线走通,Meta将拥有与OpenAI/Google不同的技术壁垒

但现实是

- JEPA目前只在特定任务上展示了优势(物理推理、规划)

- 在文本生成、代码、创意写作等LLM的核心优势领域,JEPA远未成熟

- 从实验室到产品,JEPA可能还需要3-5年的验证期

行动建议

- 研究者:JEPA是一个值得跟踪的方向,但不应该放弃LLM路线——短期内LLM仍是主力

- 投资者:关注Meta在JEPA方向的投入节奏,以及是否出现开源实现

- 开发者:现阶段继续深耕LLM生态,但可以在规划/物理推理场景尝试JEPA的实验性应用

- 企业决策者:LLM已经可以落地,不需要等JEPA——但可以在技术雷达上标记这个方向

LeCun赌的是**“全行业在一条路上卷到头,而另一条路可能更好”**。这个赌注是否正确,2026-2027年会有更多答案。但有一点可以肯定:AI路线之争远未结束。