核心结论

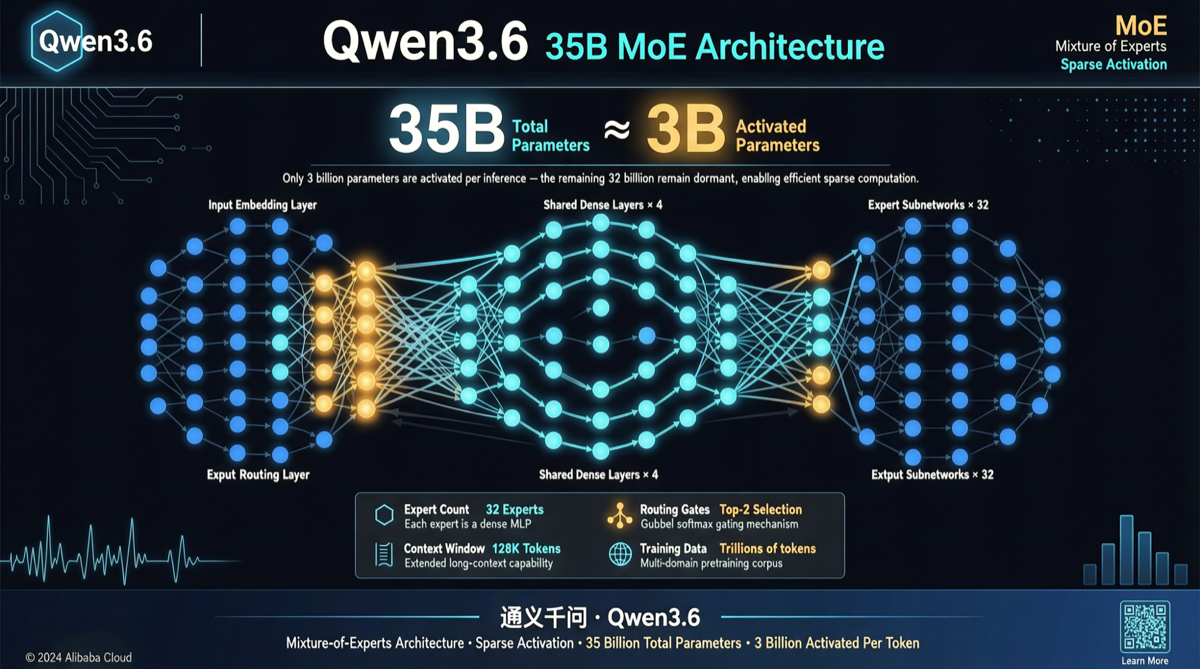

通义千问团队在 Hugging Face 上线 Qwen3.6-35B-A3B,这是 Qwen3.6 系列的首个开源变体。35B 总参数、推理时仅激活 3B,采用 256 专家 MoE + Gated DeltaNet 混合架构,Apache 2.0 许可,原生支持 262K 上下文窗口,可扩至 100 万 token。

| 维度 | Qwen3.6-35B-A3B |

|---|---|

| 总参数 | 35B |

| 激活参数 | 3B |

| 专家数 | 256(激活 8 路由 + 1 共享) |

| 上下文 | 262K 原生,可扩展至 1M |

| 许可证 | Apache 2.0 |

| 架构 | Gated DeltaNet → MoE + Gated Attention → MoE |

| 多模态 | 内置 Vision Encoder(Image-Text-to-Text) |

发生了什么

架构:Gated DeltaNet 与 MoE 的混合设计

Qwen3.6-35B-A3B 的核心创新在于 混合注意力布局:

10 × [

3 × (Gated DeltaNet → MoE)

1 × (Gated Attention → MoE)

]这种设计不是简单的 MoE 堆叠,而是将 线性注意力(Gated DeltaNet) 和 全局注意力(Gated Attention) 交替组合,每 3 层 DeltaNet 配 1 层全局注意力。DeltaNet 负责高效的局部上下文建模,全局注意力层确保长距离信息传递不被衰减。

具体参数:

- 40 层,隐藏维度 2048

- Gated DeltaNet:32 个 V 头 + 16 个 QK 头,头维度 128

- Gated Attention:16 个 Q 头 + 2 个 KV 头(GQA),头维度 256

- MoE:256 个专家,每次激活 8 个路由专家 + 1 个共享专家,专家中间维度 512

- 词表大小:248,320(padding 后)

推理效率:3B 激活参数意味着什么

3B 激活参数在当前开源 MoE 模型中属于极低水平。对比:

| 模型 | 总参数 | 激活参数 | 激活占比 |

|---|---|---|---|

| Qwen3.6-35B-A3B | 35B | 3B | 8.6% |

| DeepSeek V4 | 1.6T | 37B | 2.3% |

| Ling-2.6-Flash | 104B | 7.4B | 7.1% |

| Kimi K2.6 | ~1T | ~32B | 3.2% |

Qwen3.6-35B-A3B 的绝对激活参数(3B)远低于其他模型,这意味着:

- 单卡可运行:INT4 量化后只需约 1.5-2GB 显存即可加载激活部分

- 低延迟推理:相比 27B dense 模型(如 Qwen3.6-27B),推理速度快数倍

- 多路并发:同一张 A100 可同时运行多个实例,适合高吞吐场景

多模态原生支持

不同于 Qwen3.6-27B 的纯文本模型,Qwen3.6-35B-A3B 是 Image-Text-to-Text 架构,内置 Vision Encoder。这意味着它可以直接处理图文混合输入,无需外挂视觉模型。配合 262K 原生上下文,适合长文档+插图的复杂理解任务。

Qwen3.6 系列的两个关键升级

官方博客提到的两个核心改进方向:

- Agentic Coding 增强:前端工作流和仓库级推理能力显著提升,意味着在代码 Agent 场景下的工具调用链更长、更稳定

- Thinking Preservation(思考保留):新增选项可从历史消息中保留推理上下文,减少迭代开发中的重复推理开销——这对需要多轮交互的 Agent 工作流尤为关键

为什么重要

1. 填补 Qwen3.6 系列的 MoE 空白

Qwen3.6 系列此前主要发布了 dense 模型(如 27B)。35B-A3B 是首个 MoE 变体,补全了产品线的关键一环:

- 27B dense:适合不需要 MoE 复杂度、追求稳定性的场景

- 35B-A3B MoE:激活参数仅 3B,性能逼近更大的 dense 模型,适合成本敏感的高并发场景

- 更大规模:后续可能还会有更大的 MoE 变体

2. 消费级 GPU 友好

3B 激活参数 + 2048 隐藏维度 = 极低的推理门槛。在消费级 GPU 上的部署场景:

# RTX 4090 (24GB) 可轻松运行

# INT4 量化后约 2GB 显存占用激活部分

# 剩余显存可用于 KV Cache,支持长上下文这意味着个人开发者和小团队可以用低成本部署一个多模态 MoE 模型,无需依赖云端 API。

3. 混合架构的探索价值

Gated DeltaNet + MoE 的组合在开源社区并不常见。DeltaNet 作为一种线性注意力变体,在长序列建模上有天然优势,配合 MoE 的稀疏计算,可能代表了一种新的效率-性能权衡范式。如果 benchmark 表现验证了这一设计的优势,其他开源团队可能会跟进类似架构。

竞品对比

| 模型 | 总参数 | 激活参数 | 上下文 | 多模态 | 许可证 | 部署门槛 |

|---|---|---|---|---|---|---|

| Qwen3.6-35B-A3B | 35B | 3B | 262K→1M | ✅ | Apache 2.0 | 消费级 GPU |

| Qwen3.6-27B | 27B | 27B | 128K | ✅ | Apache 2.0 | 单卡 4090 |

| DeepSeek V4 | 1.6T | 37B | 128K | ❌ | MIT | 多卡 A100 |

| Ling-2.6-Flash | 104B | 7.4B | 256K | ❌ | MIT | 单卡 4090 |

| MiMo-V2.5-Pro | 1T | 42B | 1M | ❌ | MIT | 多卡 A100 |

Qwen3.6-35B-A3B 的独特定位:最低的绝对激活参数 + 原生多模态 + Apache 2.0 商用许可。

行动建议

谁应该关注

- Agent 开发者:Thinking Preservation 功能直接优化了多轮 Agent 调用的效率

- 低成本部署团队:3B 激活参数意味着极低的推理成本和硬件门槛

- 多模态应用开发者:原生 Image-Text-to-Text 架构,无需额外视觉模型

- 长上下文需求方:262K 原生、可扩展至 1M 的上下文窗口

如何上手

pip install transformers accelerate

from transformers import AutoModelForCausalLM, AutoTokenizer

model = AutoModelForCausalLM.from_pretrained(

"Qwen/Qwen3.6-35B-A3B",

device_map="auto",

torch_dtype="auto"

)兼容 vLLM、SGLang、KTransformers 等推理框架。

需要注意的点

- 作为 Qwen3.6 首个开源变体,社区 tooling(Ollama 适配等)可能还在跟进

- 3B 激活参数的代价是总参数 35B,全量加载仍需一定显存(需 MoE 推理框架支持稀疏加载)

- benchmark 的具体数值需参考官方博客,当前页面未完全展开

- Apache 2.0 许可允许商用,但需遵守许可条款

主要来源: