Ключевые находки

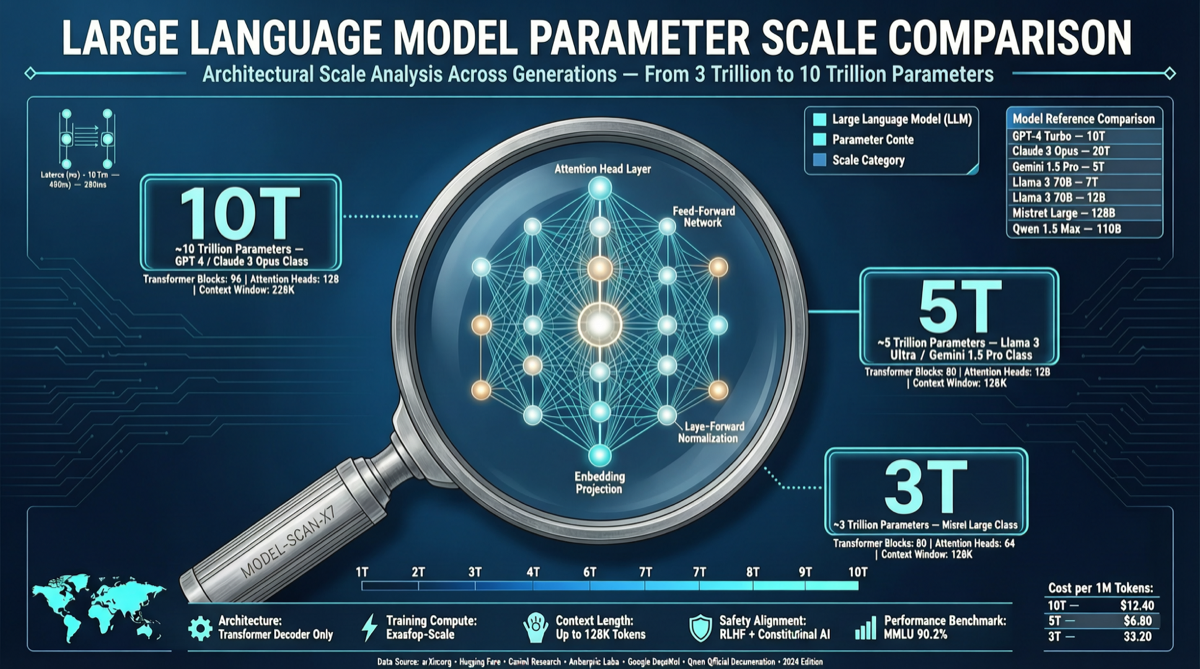

GPT-5.5 ~10 триллионов, Claude Opus ~4-5 триллионов, Grok 4 ~3 триллиона.

Метод «зонда знаний»

Основан на принципе: больше параметров → больше знаний → больше ответов на редкие вопросы. С использованием открытых моделей как базиса для обратного расчёта закрытых.

Что означают цифры

- GPT-5.5 ~10T: в 5.7 раз больше GPT-4

- Claude Opus ~4-5T: вдвое меньше, но лидирует в Arena Elo — победа эффективности

- Grok 4 ~3T: наименьший, но 2-е место в Arena Elo

Прозрачность китайских моделей

Китайские открытые модели (Kimi K2.5, DeepSeek V4, Qwen 3.6) прозрачно публикуют параметры, получая высокую достоверность в научном сообществе.

Оценка

Гонка параметров входит в новую фазу: OpenAI — brute force, Anthropic — эффективность, Китай — прозрачность + экономичность.