核心发现

一家研究团队用一种巧妙的方法估算了所有前沿闭源 LLM 的参数规模:

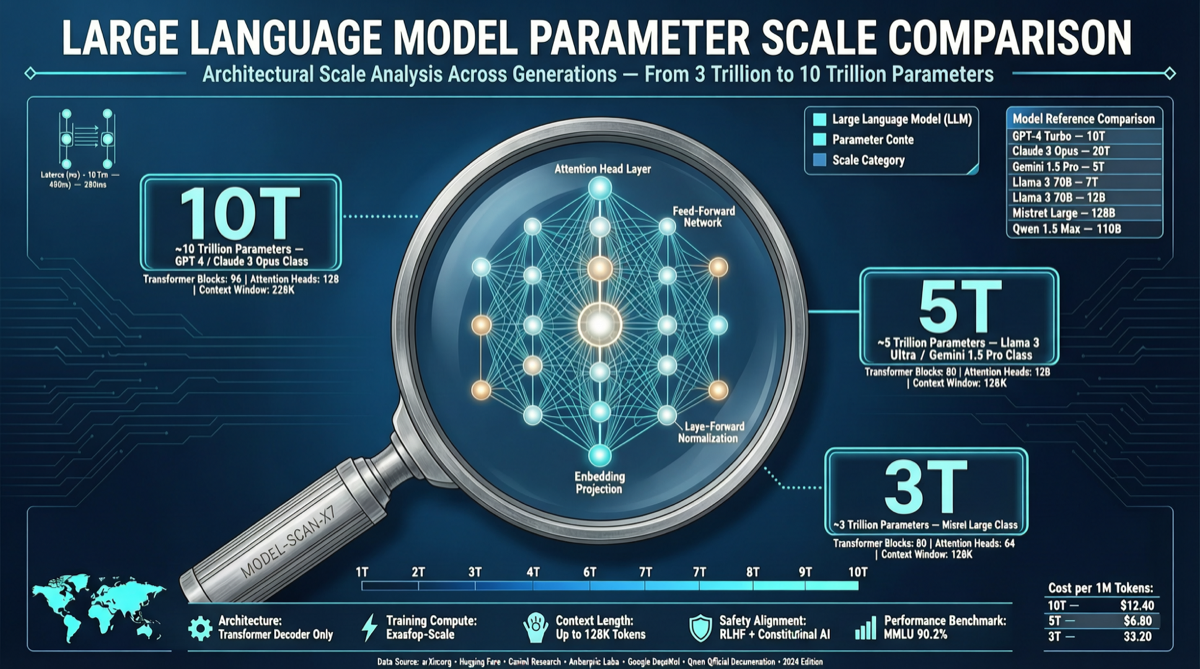

| 模型 | 估算参数量 | 估算方法 | 可信度 |

|---|---|---|---|

| GPT-5.5 | ~10 万亿 | 知识深度探针 | 中 |

| Claude Opus 4.x | ~4-5 万亿 | 知识深度探针 | 中 |

| Grok 4 | ~3 万亿 | 知识深度探针 | 中 |

| Kimi K2.5 | 1 万亿(官方公布) | — | 高 |

| DeepSeek V4 | 6710 亿(官方公布) | — | 高 |

关键发现:闭源模型的参数规模差异巨大,GPT-5.5 比 Claude Opus 大了约 2 倍。

“知识探针”方法原理

这个方法的核心思路很直接:

参数越多 → 记住的知识越多 → 能回答的冷门问题越多

具体操作:

- 构建知识梯度问题集:从常识问题到极其冷门的专业知识,按稀有度分级

- 测试各模型的准确率曲线:观察模型在什么稀有度开始”掉知识”

- 拟合参数-知识关系:利用已知参数量的开源模型(如 LLaMA、Kimi K2.5)建立基准曲线

- 反推闭源模型参数量:根据闭源模型的知识保留率,在基准曲线上找到对应的参数规模

这个方法类似用”词汇量测试”估算一个人的阅读量。

这些数字意味着什么

GPT-5.5 ~10T 参数

10 万亿参数是什么概念?

- 是 GPT-4(约 1.76 万亿)的约 5.7 倍

- 是目前公开参数最多的模型

- 解释了为什么 GPT-5.5 在 Terminal-Bench 2.0 上达到 82.7%(远超 Claude Opus 4.7 的 69.4%)

Claude Opus 4.x ~4-5T 参数

Claude 的参数量大约是 GPT-5.5 的一半,但:

- 在 LMSYS Arena Elo 排名中 Anthropic 仍领先(1,503 vs OpenAI 的 1,481)

- 说明 Anthropic 可能在训练数据质量、对齐方法或架构效率上更有优势

- 更少的参数 + 更好的效果 = 更高的效率

Grok 4 ~3T 参数

Grok 4 的参数规模在三大闭源模型中最小,但:

- xAI 在 Arena Elo 排名中位列第二(1,495)

- 说明 Grok 4 的效率也很高

- 可能与 Grok 的训练数据(X/Twitter 实时数据)有关

方法论的局限性

这种方法有几点需要注意:

- 知识 ≠ 参数:模型可以通过更好的训练数据或架构设计,用更少的参数记住更多知识

- MoE 架构的复杂性:对于 MoE 模型,“总参数”和”激活参数”的区别很大(如 Kimi K2.5 有 1 万亿总参数但只激活 320 亿)

- 校准问题:开源模型作为基准可能不够代表性

- 统计误差:估算值的误差范围可能在 ±30% 甚至更大

所以这些数字应该被视为数量级估计而非精确值。

为什么这种研究很重要

在闭源模型主导前沿能力的时代,研究者缺乏直接访问模型架构的途径。“知识探针”方法提供了一种:

- 无需 API 访问的能力评估手段

- 跨模型比较的客观基准

- 趋势追踪的方法——随着时间推移,可以观察各公司的参数增长轨迹

这种研究对于 AI 透明度、安全评估和竞争分析都有价值。

与中国模型的关系

有趣的是,主要中国开源模型的参数规模都是官方公布的:

- Kimi K2.5: 1 万亿总参数 / 320 亿激活参数

- DeepSeek V4: 6710 亿参数

- Qwen 3.6: 多种规格(7B、72B、235B 等)

这种透明度让中国模型在学术界和研究社区中获得了更高的可信度。相比之下,美国闭源模型的参数规模需要靠”猜测”。

格局判断

参数规模竞赛正在进入新阶段:

- GPT-5.5 的 10T 说明 OpenAI 在 brute force 路线上走得很远

- Claude Opus 的 4-5T 说明 Anthropic 在效率路线上走得更精

- 中国开源模型 的透明参数 + 高性价比,正在改变竞争规则

下一个值得关注的问题:当参数规模增长遇到边际收益递减时,竞争焦点会转向哪里?训练数据?架构创新?还是多代理能力?

行动建议

- 研究者:可以基于这种方法构建更系统的模型评估框架,加入更多维度(推理能力、安全性等)

- 企业用户:参数规模不是选择模型的唯一标准,效率(效果/成本比)更重要。Claude Opus 用一半参数达到可比效果是典型案例

- 政策制定者:闭源模型缺乏透明度是一个系统性风险,需要推动某种形式的模型信息披露标准