推理速度这回事,现在拼的已经不是模型大小,而是你怎么在硬件上榨出每一滴性能。

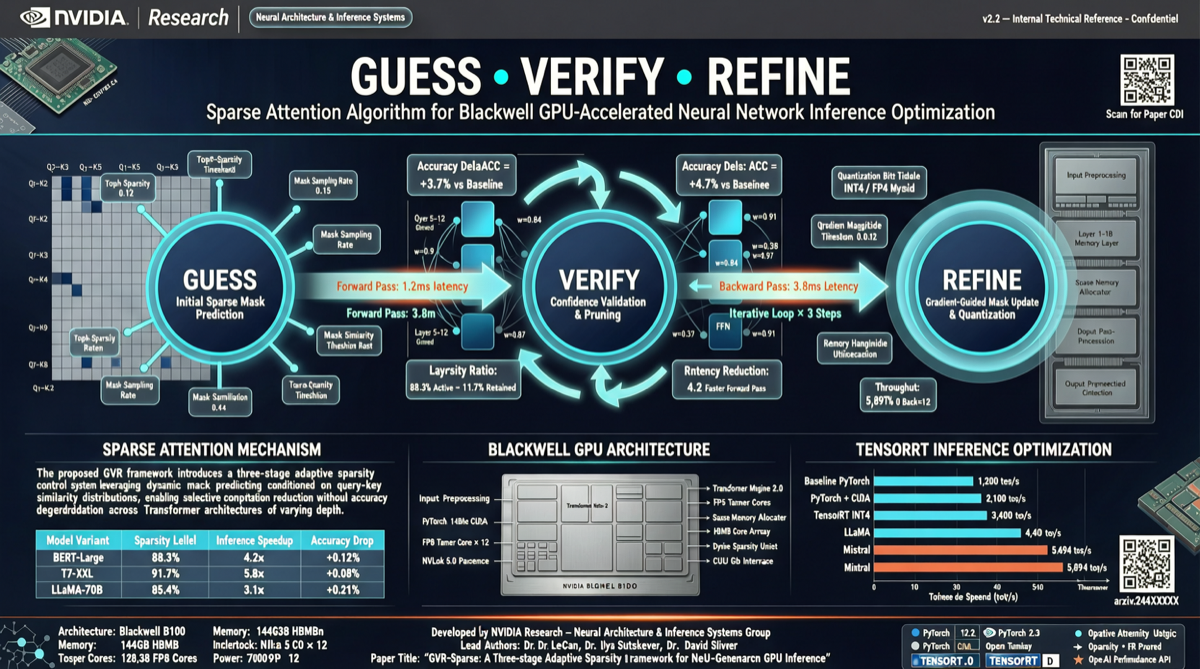

NVIDIA Research 今天在 X 上发布了一个叫 Guess-Verify-Refine 的新算法,专门针对 TensorRT-LLM 在 Blackwell GPU 上的推理加速。核心思路听起来简单得有点意外:利用相邻解码步之间的时间模式复用——上一个 decode 步算出来的东西,给下一个步当"预猜测",然后验证、修正。

结果是 Top-K 注意力加速 1.88 倍。

算法思路

Large Language Model 的自回归解码有一个特点:相邻步的注意力模式往往高度相似。前一步算过的"哪些 token 最重要",下一步大概率也差不多。

Guess-Verify-Refine 把这个直觉变成了算法:

- Guess:用上一步的 Top-K 结果作为当前步的候选

- Verify:验证这些候选在当前步是否仍然有效

- Refine:对不满足的部分做补充计算

这本质上是一种硬件感知的稀疏注意力策略——不是每次都算全量注意力,而是猜一个子集,验证它,不够再加。和传统的 speculative decoding 思路有相似之处,但针对的是注意力计算本身,而不是 token 生成。

为什么在 Blackwell 上效果好

Blackwell 架构对稀疏计算有专门的硬件优化。Tensor Core 的稀疏模式支持、更大的 SRAM 缓存、以及改进的内存带宽利用率,让"算一部分、跳过一部分"的策略收益最大化。

NVIDIA 自己的算法跑在自己的硬件上,这个优势不是巧合。

实际意义

1.88 倍的 Top-K 注意力加速,对端到端推理速度的提升取决于注意力计算在整体推理中的占比。对于长上下文场景(上下文越长,注意力计算越重),这个数字的放大效果会更明显。

但也要冷静看待:这是 NVIDIA Research 发布的算法,目前还没有公开的开源实现或第三方复现。1.88 倍是在什么场景、什么模型、什么序列长度下测出来的,NVIDIA 没有给出完整细节。

观察点

我会关注几个问题:

- 开源时间:NVIDIA Research 的算法通常会在论文中公开细节,但 TensorRT-LLM 的集成需要额外时间。

- 泛化性:这个算法对其他 GPU 架构(Ampere、Hopper)效果如何?还是只在 Blackwell 上才有显著收益?

- 社区复现:llama.cpp、vLLM 等开源推理框架会不会跟进类似的优化?

硬件感知的推理优化正在成为模型部署中最重要的差异化因素。模型能力大家都能用 API 调,但谁能把同样的模型跑得更快、更便宜,才是真正拉开差距的地方。

相关阅读:

主要来源:

- NVIDIA Research X 发布

- NVIDIA Research 官方博客(待确认)